Как решить проблемы с индексацией сайта в Google и Яндексе

Кратко самое важное об основах: как решить проблемы с индексацией и ускорить ее в Яндексе и Google.

Привет! Это PR-CY, мы делаем сервис для проверки SEO и позиций в ПС. Попробуйте прогнать проверку по своему сайту и посмотрите, какие ошибки он найдет.

В статье разберем типичные проблемы, а потом поговорим об ускорении. Постараемся лаконично)

Если роботы и Яндекса, и Google игнорируют страницы сайта, нужно убедиться, что ботам не запретили обход.

Проверьте настройки хостинга и файл robots.txt — там не должно быть запрета на индексацию.

Также запрет может быть в HTTP-заголовке X-Robot-Tag, который находится в файле конфигурации сервера. Проверить запрет через X-Robots-Tag можно в инструменте бесплатно.

Если либо Google, либо Яндекс не индексируют страницы сайта, проблема может быть в санкциях от этого поисковика.

Нужно определить, какие санкции лежат на сайте, и исправить ошибки. Проверьте уведомления о Вебмастере и Консоли, часть санкций сопровождаются письмом от поисковика. Подробно в материалах о санкциях Яндекса и фильтрах Google.

Вариантов может быть много: вы редко обновляете контент, поэтому боты редко его посещают, страницы не оптимизированы, не участвуют в перелинковке… Проблема может быть в других ошибках на сайте, например, в куче ошибочных лишних страниц, сгенерированных движком, на которые тратится время.

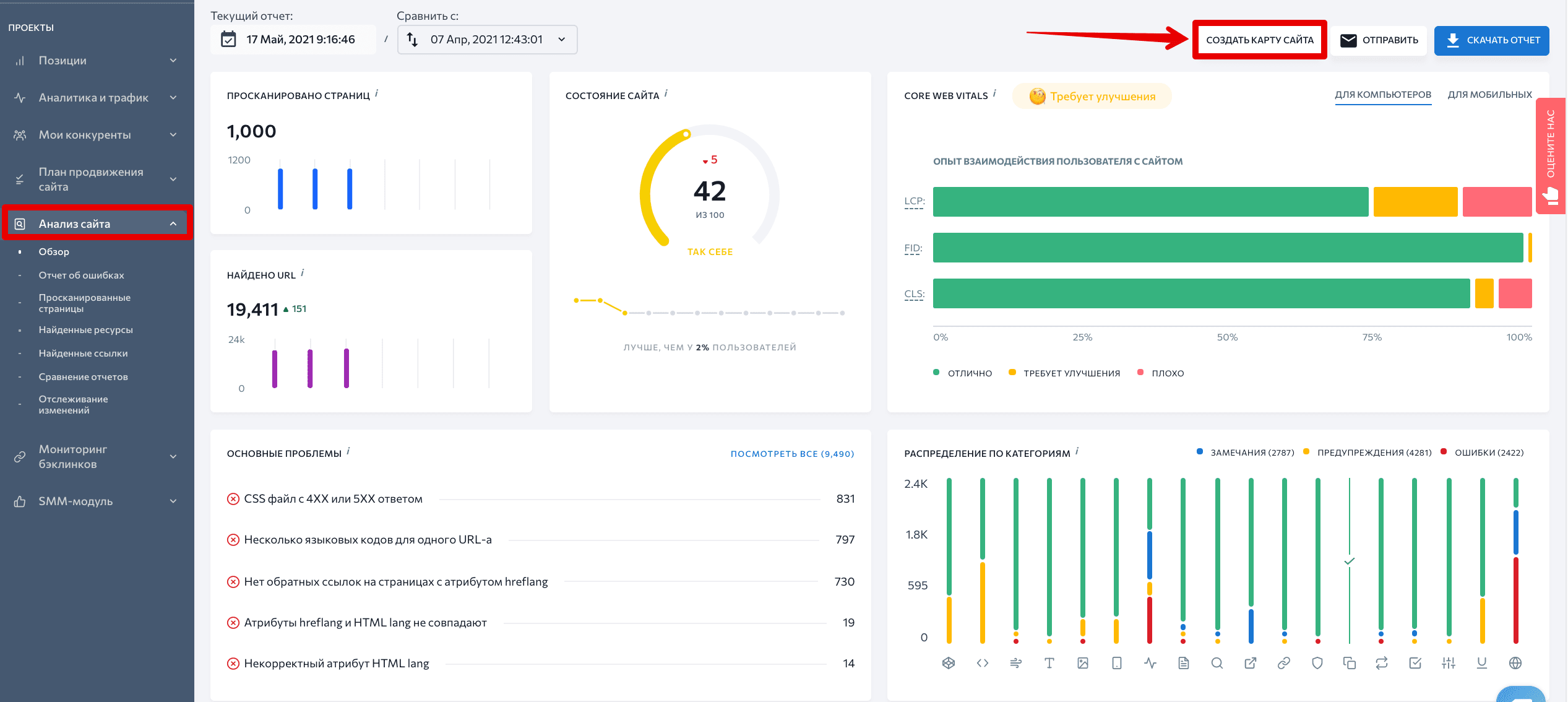

Посмотреть динамику индексации страниц и найти ошибки в SEO можно в сервисе для анализа сайта:

Итак, если страницы не индексируются, то проверьте ограничения, если игнорирует поисковик, то возможны санкции, а если индексирование идет, но долго, это повод попытаться его ускорить.

Лучший способ улучшить процесс индексирования — создавать превосходный, а значит уникальный и убедительный контент. Именно в нем должны нуждаться пользователи, именно его они затем будут рекомендовать другим

Ага, классно. Создавайте превосходный контент, а если ваш контент плохо индексируется, то он недостаточно превосходный… ��

Что реально можно сделать, чтобы ускорить процесс.

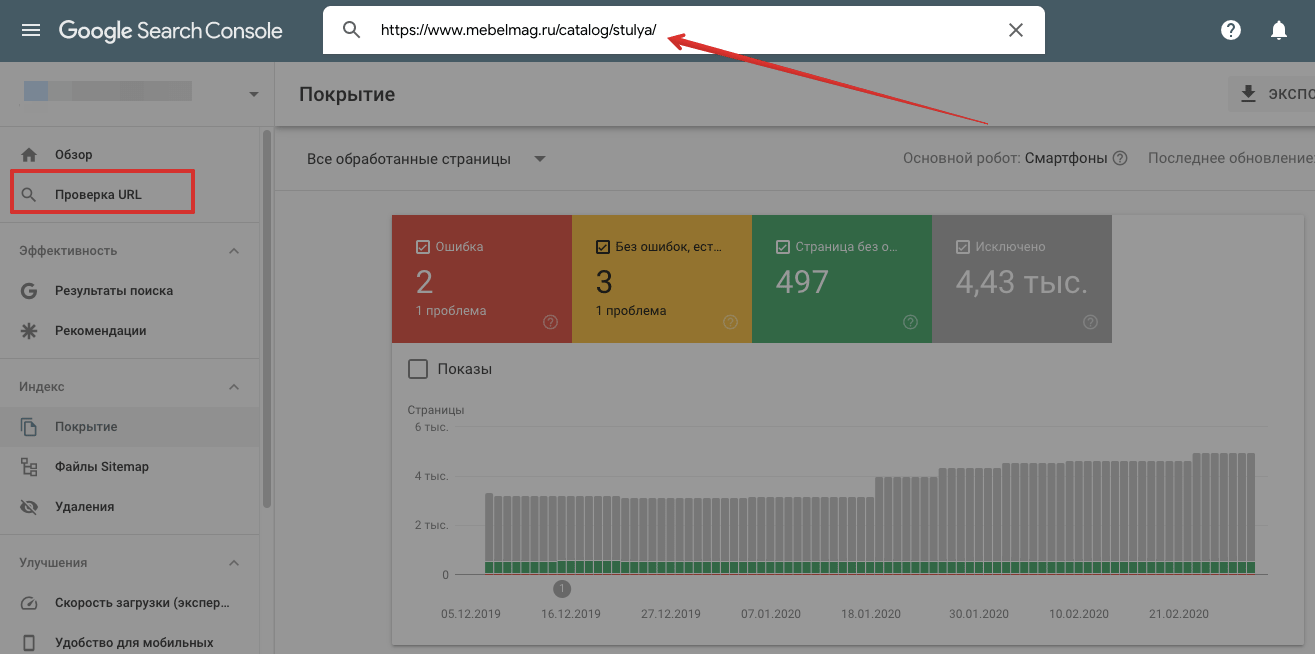

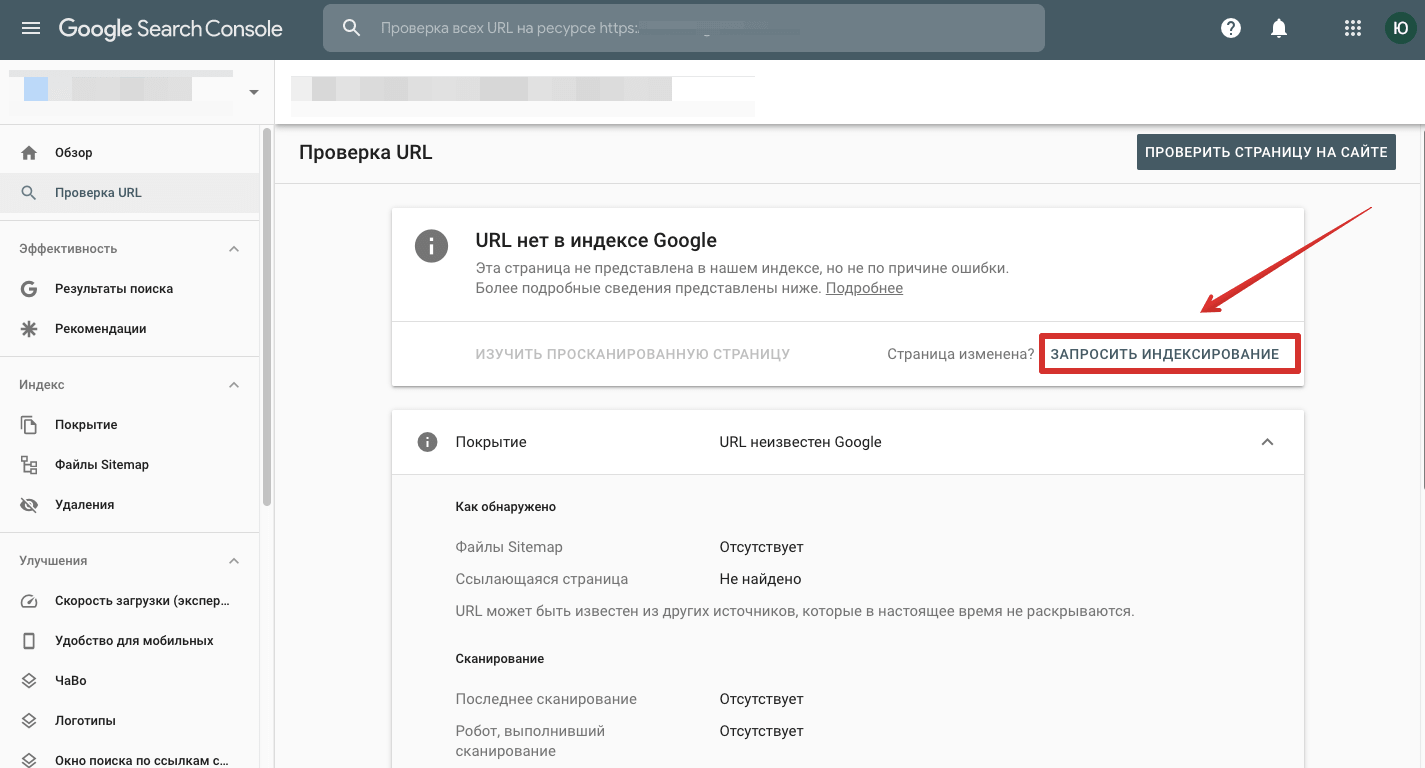

Найдите переобход страниц в Google Search Console и Яндекс.Вебмастере и отправьте нужные URL на индексацию.

В Яндекс.Вебмастере это раздел Индексирование — Переобход страниц. В консоли Google это Инструмент проверки URL.

В файле robots.txt веб-мастер прописывает рекомендации для поисковых ботов Яндекса и Google. Можно запретить ботам посещать некоторые страницы, для этого есть директива «disallow», «nofollow», можно использовать мета-тег «noindex» или «none». Тогда при следующем посещении сайта бот увидит запрет и может к нему прислушаться.

А может и не прислушаться — это всего лишь рекомендации, а не прямое указание. ��♂

Поисковики ценят, когда веб-мастер следит за актуальностью контента, исправляет его и добавляет что-то новое. Регулярно обновляющийся сайт бот будет чаще сканировать. Чем реже обновлять контент, тем реже боту понадобится его перепроверять.

Сотрудник Google советовал добавлять на страницу видео с Youtube, если странице нечего добавить и содержание еще актуально. Поведенческие улучшатся за счет просмотра видео, на странице появится новый формат контента — это тоже хороший сигнал для поисковика.

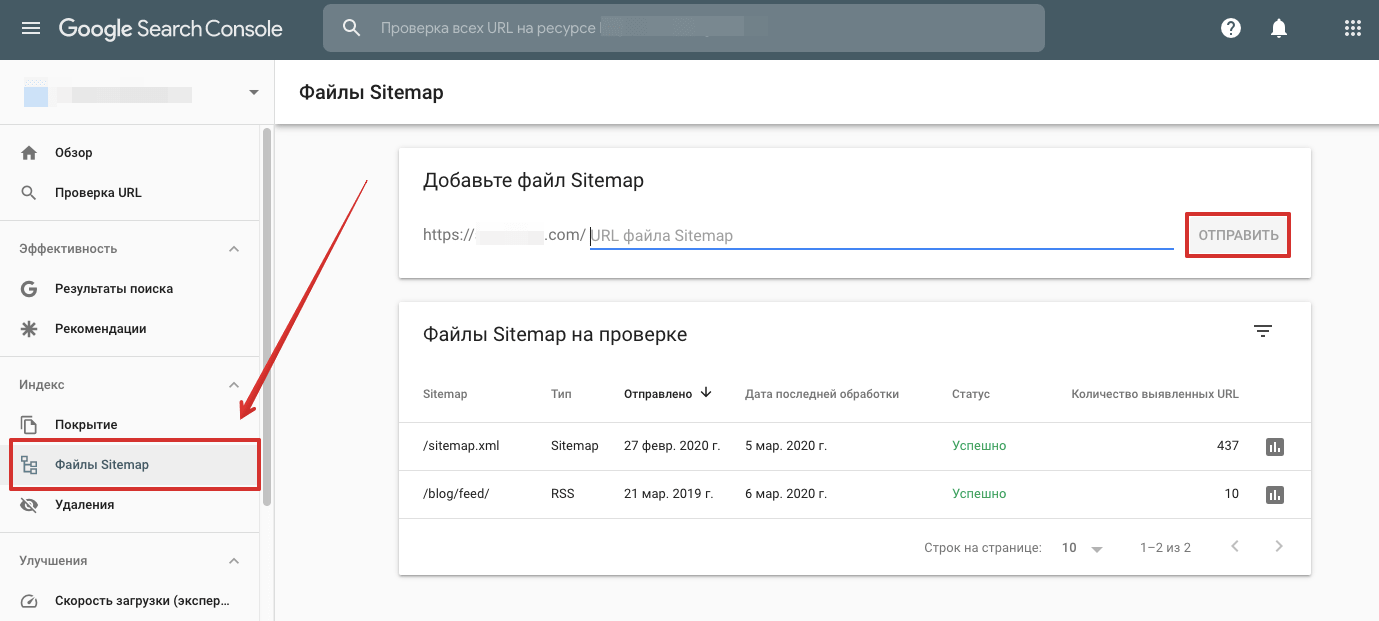

Для ускорения индексации карту можно сделать динамической, то есть по мере создания новых страниц она сама будет обновляться.

Для проектов на конструкторах сайтов, например, на Tilda, карта по умолчанию динамическая, для CMS есть плагины и отдельные сервисы. К примеру, на WordPress с этой задачей справится All in One SEO Pack.

Можно указать обновленные файлы в Sitemap вручную. Google рекомендует отметить страницы в Карте тегом < lastmod > и отправить страницу на переобход.

Но, опять же, ссылки в Карте сайта — это рекомендации.

На сайте не должно быть страниц, оторванных от других. Если на страницу не ведут ссылки с категорий, разделов и других страниц, поисковикам сложнее определить ее релевантность и неоткуда перейти на нее для сканирования.

Как сделать так, чтобы новый сайт быстро добавился в поисковые системы Яндекс и Google и начал индексироваться?

Для начала проясняю: в этой статье я описываются общие моменты для новых сайтов с использованием новорегов (новых доменов без истории). Подробнее описывать как регистрироваться и заводить аккаунты я не намерен, так как при желании с этим любой справится.

Берем в учет то, что сайт уже разработан и просто лежит где-то на тесте.

Честно сказать, задачка не из простых.

Итак, поехали: выберете тематику вашего сайта и точно определитесь с тем, что хотите продвигать. Это нужно для того, чтобы у вашего сайта в последствии было максимально релевантное доменное имя к основному запросу. Затем выберете доменное имя, это можно сделать на таких площадках как: nic.ru, reg.ru, beget.com/ru и многих других.

Выбирая домен, нужно учесть несколько основных принципов:

Домен должен быть коротким

Если вы продвигаете проект по РФ или любом регионе России, то доменная зона должна быть .ru (это будет правильнее, нежели для сайта с регионом продвижения к примеру «Владимир» использовать домен с зоной .kz)

Очень хорошо, если выберете домен под тематику сайта, к примеру если у вас будет интернет-магазин светильников или других световых приборов, то в названии было бы круто это использовать и делать домен формата:

да, в поисковой выдаче никуда не деться от маркетплейсов, но можно быть более релевантными при наличии хорошего ассортимента товаров и грамотной оптимизации.

Где будут храниться файлы моего сайта?

Файлы сайтов обычно хранятся на хостинге или сервере.

Лучшим вариантом для сайта является сервер и можно для этих целей использовать технологию одной из топовых поисковых систем — Yandex Compute Cloud, это будет не сильно дороже чем если взять хостинг, при этом сервера яндекса также находятся в России и поэтому для продвижения сайтов в РФ, это очень круто.

Бывает, что нет финансовой возможности оплачивать сервер. В этом случае, вам помогут хостинги, коих огромное количество. Один из самых стабильных хостингов, что мне попадались — это как раз Beget. Есть хостинги лучше, есть хуже, но его можно посоветовать для маленьких и средних по размерам (до 10 гигабайт) и трафику (до 5000 уников в сутки) проектов.

Если же у вас большие планы, то всё-таки нужен сервер.

Кстати говоря на хостингах обычно в продаже имеются домены, возможно вы сможете что-нибудь подобрать для себя прямо там.

Выкладываем на хостинг

Теперь мы можем выложить файлы сайта на хостинг, привязав к домену. Рекомендую купить хороший ssl сертификат, не используя бесплатный, а также купить выделенный ip адрес. Это нужно, чтобы поисковые системы быстрее поняли, что перед ними не сайт-однодневка.

Настроить ответы сервера

чтобы 404 ответ отдавался для страниц, которые должны отдавать 404 ответ (проверяется со стороны сервера)

чтобы страницы, которые должны отдавать 200ок, отдавали этот ответ. (проверяется со стороны сервера)

настроить 304 ответ Last-Modified (проверить эту настройку можно тут: https://last-modified.com/ )

Также нужно использовать http 2 версии (проверяется тут: https://http2.pro/ )

Настройте апачи или nginx:

301 редирект всех URL с http на https

301 редирект всех URL с www на без www

301 редирект всех URL без / на конце на со / , либо редирект со / на конце на без /

3 пункт вариативный для новых сайтов, а первые 2 советую оставить в таком формате.

Расписывать по коду нет смысла, так как для разных систем настраивается по-разному и это отдельная тема для статьи.

Robots.txt

Генерируем файл robots.txt, в него нужно прописать закрывающие директивы, исключающие системные файлы и страницы, которые не нужны поисковым роботам. Полностью всё о настройке можно будет найти в статье.

Автогенерирующийся Sitemap.xml

Почему рекомендую именно автогенерирующийся? Ответ прос: вы не будете на ежедневной основе обновлять данные в этом файле, тем более что поисковые системы любят ежедневное обновление контента и наполнение страницами вашего нового ресурса.

О том в каком формате должна быть карта сайта и что там должно быть, лучше рассказано в статье.

Фавиконки

Фавиконка по требованиям яндекса должна быть размером: 120 × 120, 32 × 32 или 16 × 16 пикселей или в формате svg.

Ещё фавикон хорошо устанавливать для всех устройств и разрешений:

Подробнее о том, как вставит фавикон для всех устройств: тут.

Настройка микроразметки Open Graph

Должна быть настроена данная микроразметка для всего проекта.

Пример:

<meta property=»og:title» content=»title страницы» />

<meta property=»og:description» content=»description страницы» />

<meta property=»og:site_name» content=»Winrating» />

<meta property=»og:type» content=»website» />

<meta property=»og:url» content=»URL страницы»>

<meta property=»og:image» content=»картинка для страницы» />

<meta property=»og:image:width» content=»310″>

<meta property=»og:image:height» content=»310″>

<meta name=»twitter:card» content=»summary_large_image»>

<meta property=»twitter:title» content=»title страницы»>

<meta property=»twitter:description» content=»description страницы»>

<meta name=»twitter:image» content=»картинка для страницы»>

<meta name=»twitter:image:src» content=»картинка для страницы»>

<meta property=»twitter:image:width» content=»310″>

<meta property=»twitter:image:height» content=»310″> <meta property=»twitter:site» content=»@твиттер проекта»>

Настройка микроразметки Schema.org

Как минимум нужно разметить данные об организации, хлебные крошки, поиск, меню, рейтинги, товары (при наличии), отзывы (при наличии).

Подробнее о настройке schema.org можно прочитать тут.

Настройка canonical

Каноникл настраивается для страниц пагинации: со всех страниц пагинации нужно настроить каноникл на основную страницу, либо есть вариант лучше как показывает практика: используем для пагинаций старый формат в head:

<meta name=»robots» content=»noindex, follow»/>

При таком коде в head страниц пагинаций, не будут индексироваться пагинации, при этом контент на них индексироваться будет, будь то карточки товаров или статьи.

Настройка страниц пагинаций (если есть)

Для стараниц пагинаций нужно в title, description и h1 дописать: страница пагинации номер и номер пагинации на которой находимся.

Если у вас страницы статей, то можно выводить по 40-60 статей на 1 страницу пагинации

Если карточки товаров, то выводим по 80-120 карточек товаров на 1 страницу.

Добавление сайта в поисковую систему Яндекс

Для добавления сайта в поисковую систему Яндекс, нужно встроить код на все страницы проекта / вставить файл верификации в корень сайта или прописать dns.

Заходим на сайт https://webmaster.yandex.ru/

Нажимаем на кнопку с плюсиком:

Добавляем в вебмастер

Вариант 1: Скачиваем файл верификации

Вот он скачался:

Теперь этот файл нужно залить на FTP (доступ к ftp выдается вместе с правами на хостинг, посмотрите на почте). Очень важно залить файл или в корень сайта или в шаблон (в зависимости от того как сайт сделан). В этом очень хорошо помогает софт: Filezilla

Итак мы залили файл верификации, теперь возвращаемся в вебмастер и нажимаем на кнопку проверить:

Это был описан первый из трех способов, давайте опишу и другие:

Вариант 2: Добавляем код html в код главной страницы вашего сайта (в раздел head)

Чтобы добавить его на сайт, нужно просто его скопировать, найти код главной страницы, к примеру в нашем случае это index.php и встроить его внутрь.

После чего идем по стандартной схеме и подтверждаем в вебмастере права на сайт:

Вариант 3: DNS запись.

Очень часто бывает, что в популярных cms (система управления сайтом) сисемах, есть возможность встроить DNS запись. Либо же на хостингах имеется такая возможность. Вам потребуется только код файла верификации:

Встраиваем его в админку:

Затем снова возвращаемся в вебмастер и нажимаем на подтверждение.

Добавление в ПС GOOGLE

Процедура верификации проектов в Google ничем не отличается от процедуры верификации проектов в Яндекс.

Также заходим на сайт: https://www.google.com/webmasters/tools/home?hl=ru

И делаем абсолютно те-же действия на выбор что и для яндекса:

заливаем файл верификации

Или встраиваем в head код для главной страницы

Или прописываем DNS

Если все действия выполнены правильно, то сайт обязательно добавится.

У меня не получилось добавить сайт в вебматер, что делать?

Очень часто люди сталкиваются с проблемой того, что вроде всё сделали, но почему-то яндекс не видит верификации и не пропускает после нажатия на кнопку «проверить».

Основными причинами этого могут стать такие моменты как:

Файл верификации залит не в корень сайта или не в папку с шаблоном сайта

DNS запись пока не обновилась

Встроили код верификации не в head главной страницы, а к примеру в body))) и такое бывает.

Если у вас самих не получилось исправить ситтуацию, нужно обратиться к разработчику сайта и я уверен, что он быстро всё сделает.

Я всё сделал, что дальше?

Итак мы настроили ответы сервера, настроили пагинации, сделали редиректы там, где они нужны, всё проверили и залили файлы верификации.

Далее для поисковой системы Яндекс необходимо присвоить региональность, это можно сделать тут:

Нужно определить регион продвижения, это может быть какой-либо населенный пункт, к примеру Владимир или же регион присваиваем Россия, если проект будет продвигаться по всей стране. И указываем страницу контакты, где заранее лучше всего разместить следующую информацию:

Адрес в формате: Индекс, страна, город, улица, дом, номер офиса

Если у вас ООО, то указываем: Юридический адрес и Фактический адрес (если разные, то пишем разные адреса, если один, то пишем один.)

Данные о ИП или ООО: ИНН, ОГРН или ОГРНИП

Данные счета: Расчетный счет, БИК банка, Корреспондентский счет

Также делаем заголовок h2: Как добраться?

И ниже размещаем яндекс и гугл карты

В данном случае я рассказываю именно для одного проекта без субдоменной истории, это важно учесть.

Далее переходим снова в вебмастер и указываем страницу контакты, на которой размещена вся эта информация.

Следующим шагом регистрируемся в Яндекс-Бизнес

Карточка яндекс-бизнес должна быть максимально заполненной, для этого перейдите на сайт: https://yandex.ru/sprav/companies

И заполняйте в ней абсолютно всё! Добавьте массу фотографий, добавьте данные о компании, описание, вообще всё должно быть полностью заполнено. Добавьте свои соцсети, добавьте названия на других языках и в коротком формате, всё на этой странице очень и очень важно!

Для поисковой системы Google делаем также в Google my business

Заходим на сайт: https://business.google.com/

И также в нем заполняем полностью всё, что только возможно!

Для более быстрого обхода роботами

Для более быстрого обхода поисковыми роботами нужно подключить связку с яндекс метрикой и google Analitics. Также добавить в вебмастер яндекса и google файл sitemap.xml.

Всё, сайт успешно добавлен в поисковые системы и можно его наполнять и развивать.

Затем следим ежедневно за ошибками и исправляем их при возникновении. Читайте другие статьи моего блога и я расскажу более подробно обо всех нюансах seo. Всем спасибо за внимание, пишите комментарии.

Как ускорить индексацию сайта в Яндексе и Google ��

Чем быстрее страница займет место в выдаче поисковой системы, тем быстрее ее смогут увидеть пользователи, и тем больше вероятность, что она будет считаться первоисточником контента.

Нельзя точно сказать, когда боты поисковых систем просканируют страницу и она появится в выдаче. На частоту индексирования страниц ботами влияет:

- Частота обновления контента страниц. Боты составляют краулинговый бюджет сайта на основе данных об обновлении контента. Если страницы не меняются, нет смысла их часто сканировать.

- Поведенческие факторы, которые обрабатывают поисковые боты. Чем лучше ПФ, тем востребованнее сайт у аудитории, а это еще один сигнал к повышению внимания от робота.

- Хостинг. На загруженном хостинге снижается скорость обработки запросов от робота.

Разберем типичные проблемы, с которыми сталкиваются оптимизаторы.

Частые проблемы с индексацией сайта в ПС

Страницы вообще не индексируются

Если роботы и Яндекса, и Google игнорируют страницы сайта, нужно убедиться, что ботам не запретили обход. Проверьте настройки хостинга и файл robots.txt — там не должно быть запрета на индексацию. Также запрет может быть в HTTP-заголовке X-Robot-Tag, который находится в файле конфигурации сервера. Проверить запрет через X-Robots-Tag можно в инструменте бесплатно.

Страницы не индексируются одним из поисковиков

Если либо Google, либо Яндекс не индексируют страницы сайта, проблема может быть в санкциях от этого поисковика. Нужно определить, какие санкции лежат на сайте, и исправить ошибки. Помогут материалы о санкциях Яндекса и фильтрах Google.

Страницы индексируются, но долго

Если приходится долго ждать индексации новых страниц, вариантов может быть много: контент редко обновляется и поэтому боты редко его посещают, страницы не оптимизированы, не участвуют в перелинковке или проблема в чем-то другом. Способы ускорить индексацию мы разберем дальше.

Посмотреть динамику индексации страниц и найти ошибки в SEO можно в сервисе для анализа сайта от PR-CY:

График индексации в сервисе

График индексации в сервисе

Итак, если страницы не индексируются, то проверьте ограничения, если игнорирует поисковик, то возможны санкции, а если индексирование идет, но долго, это повод попытаться его ускорить.

Как ускорить индексацию страниц

Представитель Google Джон Мюллер на вопрос об индексировании ответил так:

Создавайте превосходный контент, а если ваш контент плохо индексируется, то он недостаточно превосходный. 🙂 Это все, конечно, хорошо, но давайте посмотрим, что конкретно можно сделать, чтобы ускорить процесс.

Отправить страницу на переобход

Можно дополнительно обратить внимание поисковиков на конкретные URL. В Google Search Console и Яндекс.Вебмастере найдите переобход страниц и отправьте нужные URL на индексацию.

В Яндекс.Вебмастере это раздел Индексирование — Переобход страниц. В консоли Google это Инструмент проверки URL.

Массовая отправка страниц на переиндексацию в Google

Есть способ отправлять на повторное сканирование не по одной ссылке за раз, а по 200 URL в день. В этом мог бы помочь бесплатный скрипт, который сделал SEO-отдел компании Journey Further на базе Indexing API Google. Проблема в том, что для его работы понадобится аккаунт в Google Cloud Platform, но в марте Google перестал регистрировать пользователей из России в своем облачном сервисе.

Если вы не из РФ, можете настроить скрипт для массовой переиндексации URL. Для этого нужно:

Создать сервисный аккаунт в Google Cloud Platform.

Создать закрытый JSON-ключ.

Скачать скрипт и вставить ключ вместо содержимого service_account.

Связать скрипт с Google Search Console: назначить владельцем client_email. Нужен не полный доступ, а именно роль «Владелец».

Перейти по ссылке, выбрать сервисный аккаунт, который вы создали, и включить Index API.

В папке скрипта открыть файл urls и внести в него до 100 URL. Если нужно больше, можно отправить еще до 100 во втором заходе. В день можно отправлять не больше 200 ссылок.

Вызвать PowerShell, зажав Shift и правую кнопку мыши в окне.

Прописать node index.js.

Готово, через несколько секунд появится 200 ОК.

Проверить разрешения в robots.txt

В файле robots.txt веб-мастер прописывает рекомендации для поисковых ботов Яндекса и Google. Можно запретить ботам посещать некоторые страницы, для этого есть директива «disallow», «nofollow», можно использовать мета-тег «noindex» или «none». Тогда при следующем посещении сайта бот увидит запрет и может к нему прислушаться. А может и не прислушаться.

Как говорит Ксения Пескова, SEO-TeamLead в Siteclinic:

В любом случае, лучше проверить файл robots, вдруг там стоят запреты, к которым прислушались боты поисковых систем.

Создать Sitemap — Карту сайта

Карта сайта помогает поисковым ботам понять структуру ресурса и обнаруживать обновления контента.

Для ускорения индексации карту можно сделать динамической, то есть по мере создания новых страниц она сама будет обновляться. Для проектов на конструкторах сайтов, например, на Tilda, карта по умолчанию динамическая, для CMS есть плагины и отдельные сервисы. К примеру, на WordPress с этой задачей справится All in One SEO Pack.

Можно обновить файл Sitemap вручную. Обновленные страницы Google рекомендует отметить в Карте тегом < lastmod >. Обновленный файл отправьте с помощью специального отчета. Не стоит загружать один и тот же файл повторно: если вы ничего не поменяли в Карте сайта, никаких изменений не будет.

Но опять же, ссылки в Карте сайта — это рекомендации, важнее создать грамотную структуру сайта и организовать внутреннюю перелинковку.

Проверить структуру и перелинковку разделов

На сайте не должно быть страниц, оторванных от других. Если на страницу не ведут ссылки с категорий, разделов и других страниц, поисковикам сложнее определить ее релевантность и неоткуда перейти на нее для сканирования. Такие страницы называют сиротами.

Страница-сирота в структуре сайта

Нужно встроить их в структуру сайта. К примеру, в этой схеме каждая страница имеет ссылку с родительской категории, но они вполне могут линковаться и между собой:

Упрощенный пример структуры сайта, подходит для меню

Еще один момент, который влияет на поведение бота — это Click Distance from Index (DFI), то есть количество кликов от главной до текущей страницы. Чем оно меньше, тем важнее считается страница, тем больший приоритет она получит с точки зрения бота. Приоритетные страницы он смотрит первее остальных.

DFI не определяется по числу директорий в URL, они могут не совпадать. Например, если на главной странице будет ссылка на хит продаж — конкретную модель холодильника Atlant, то DFI будет равен двум. Но при этом карточка модели может находиться в каталоге и подразделе каталога, тогда директорий будет больше — site.com/shop/refrigerator/one_chamber_refrigerators/atlant/h_1401_100.

Если страница не индексируется, проверьте ее расположение в структуре сайта и количество кликов до нее с главной.

Александр Шестаков, руководитель продукта Links.Sape:

Взять за правило обновлять контент

Поисковики ценят, когда веб-мастер следит за актуальностью контента, исправляет его и добавляет что-то новое. Регулярно обновляющийся сайт бот будет чаще сканировать. Чем реже обновлять контент, тем реже боту понадобится его перепроверять.

Сотрудник Google советовал добавлять на страницу видео с Youtube, если странице нечего добавить и содержание еще актуально. Поведенческие улучшатся за счет просмотра видео, на странице появится новый формат контента — это тоже хороший сигнал для поисковика.

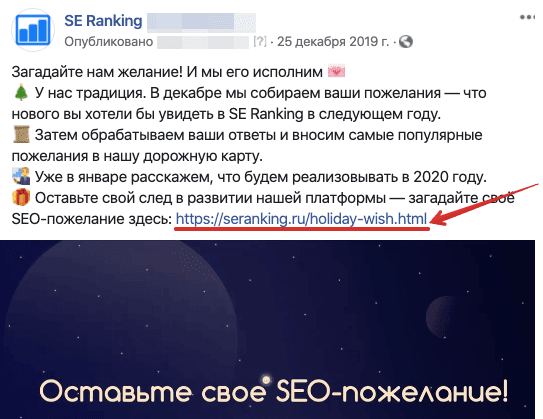

Публиковать ссылки в соцсетях и на других площадках

Найдите сторонние сайты по вашей тематике, где можно оставлять ссылки или публиковать посты, и размещайте таким образом ссылки на новые материалы.

CTO компании Pear Advert Иван Самохин:

Вы можете договориться о партнерстве с площадкой, близкой вам по тематике, и обмениваться ссылками. Главное, что размещения ссылок должны выглядеть естественными и подходить по теме. К примеру, ссылка на магазин рыболовных снастей будет уместно выглядеть на форуме рыболовов или туристическом портале. Ищите справочники, форумы, другие соцсети, отзовики, сервисы вопросов и ответов и другие площадки для размещения.

Если вы ведете страницы в социальных сетях, размещайте на них анонсы ваших новых материалов. С помощью разметки OpenGraph можно задать ссылке красивое превью с нужной картинкой и заголовком, и получить переходы пользователей на страницу.

Превью ссылки в посте в ВКонтакте

Отследить популярные страницы поможет сервис сквозной аналитики и коллтрекинга Calltracking.ru. С его помощью вы сможете понять:

- с каких страниц поступают целевые и нецелевые обращения;

- есть ли проблемы с версткой на страницах сайта;

- на какие страницы увеличивать трафик и запускать рекламу.

Сервис помогает оптимизировать рекламу с учетом всех лидов и их стоимости.

Ускорить загрузку сайта

Ограничивать индексацию может долгий ответ сервера. По словам Джона Мюллера из Google, если в среднем это время составляет больше одной секунды, Google не будет сканировать столько страниц, сколько мог бы.

Медленная загрузка страниц вредит им по всем параметрам: пользователи не ждут, а поисковые системы считают страницы некачественными и могут даже понизить сайт в выдаче, если проблема с загрузкой есть у всех страниц.

Многое можно проверить на сайте автоматически. Поможет сервис для анализа сайта: он оценит загрузку сайта и отдельно найдет конкретные страницы, на которых есть проблема со скоростью.

Проверка скорости загрузки

Проверка скорости загрузки  Поиск медленных страниц на сайте

Поиск медленных страниц на сайте

FAQ: что еще влияет на скорость индексации сайта

Как страницы вне индекса могут повлиять на отношение поисковика к сайту?

Качество контента на сайте поисковики оценивают только по проиндексированным страницам.

Тег noindex может влиять на индексацию страницы после его снятия?

По словам Джона Мюллера из Google, у веб-мастера не будет проблем с реиндексацией URL, на которых когда-то был noindex.

Как редирект влияет на индексацию страниц?

Джон Мюллер утверждает, что поисковик скорее всего не проиндексирует конечный URL при использовании ссылок с 301 редиректом.

Как ускорить индексацию страниц, которые были 404?

Если адрес страницы отдавал 404 и не был индексирован, на индексирование может потребоваться некоторое время. Как советуют Seroundtable, можно создать новый URL для этого контента и настроить 301 редирект со старого адреса, либо запросить повторное сканирование URL.

Как поисковики относятся к URL c хэшами?

URL с хешами поисковик не проиндексирует. То есть ссылка https://site.ru/news/p/statya проиндексируется, а ссылка на конкретную часть статьи — https://site.ru/news/p/statya#step — нет.

Расскажите, какие способы ускорить попадание в индекс знаете вы? Добавьте в комментариях, если мы что-то упустили в материале.

Почему важно ускорить индексацию сайта и как это сделать

Чем быстрее страницы вашего сайта проиндексирует поисковик, тем быстрее они попадут в выдачу.

У Google на процесс индексирования уходит от пары минут до семи дней. Заранее определить сроки индексации никто не может — все зависит от вашего сайта. Но есть несколько способов ускорить процесс.

Методы быстрой индексации особенно пригодятся сайтам:

- с большим количеством страниц;

- которые часто обновляют свой контент;

- владельцы которых внесли очень важные правки и хотят тут же видеть обновленные страницы в выдаче.

Перейдем к сути — что может сделать владелец сайта, чтобы поисковики как можно быстрее проиндексировали его сайт.

1. Отправьте страницы на индексацию в Google Search Console

Чтобы страницы как можно быстрее попали под радар поисковика, используйте Google Search Console. Он поможет владельцам сайтов следить за состоянием индексации, изучать ошибки во время сканирования и оптимизировать сайты.

Первые шаги в работе с Google Search Console — добавить туда свой ресурс и подтвердить право собственности. Начать можно здесь , используя подсказки . Первые данные о вашем сайте можно будет увидеть в консоли уже через пару дней.

Чтобы проверить статус индексации новой страницы, выберите на левой панели «Проверка URL» или введите нужный URL-адрес в поисковое поле сверху. Вот так просто.

После отправки URL на проверку вы увидите, проиндексирована ли эта страница, а также ошибки, связанные с AMP, разметкой и индексацией.

Если страница не проиндексирована, вы можете запросить визит робота Googlebot и отслеживать статус индексирования.

Инструмент «Проверка URL» подходит для индексации как новых страниц, так и тех, которые вы обновили.

2. Используйте преимущества карты сайта

Карта сайта XML служит навигатором для поисковых роботов, и это можно использовать для ускорения индексации.

Карта помогает поисковым роботам быстрее находить страницы сайта и быстрее их индексировать. То есть, чтобы сообщить поисковикам о том, какие страницы на вашем сайте доступны для сканирования, добавьте их в файл sitemap.xml, а ссылку на сам файл — в специальный раздел панели для веб-мастеров (ниже добавлю инструкцию).

Карта XML для поисковых систем — рекомендация, а не строгая инструкция. Она не гарантирует, что все добавленные страницы будут проиндексированы, но может действительно помочь большим сайтам быстрее и полнее проиндексироваться.

Несколько советов по созданию карты

Чтобы карта лучше сработала, она должна быть хорошо структурирована и размечена для поисковика.

Отмечайте обновленные страницы с помощью тега <lastmod> для добавления действительной даты последнего изменения, а не одной и той же даты для всех страниц.

Укажите приоритетность страниц для сканирования с помощью тега <priority> (от 0 до 1) и частоту изменений страницы (с помощью тега <changefreq>). Так поисковики получат полную информацию о вашем ресурсе. Но учтите, что частота изменений страницы может не соответствовать тому, как часто ее будут сканировать поисковые роботы. Google в настоящее время не учитывает атрибуты <priority> и <changefreq> , и поэтому их не обязательно добавлять.

Создайте отдельные карты сайта для изображений, видео, новостей , если на вашем сайте много таких материалов. Такое сегментирование поможет поисковым роботам найти контент, который сложно обнаружить с помощью обычных методов сканирования (например, он загружается через JavaScript). На большом сайте отдельные карты могут пригодиться даже для разделов и подкатегорий.

Создайте несколько карт сайта, если у вас больше 50 000 страниц или размер карты больше 50 МБ. Созданные карты нужно поместить в один индекс , в котором будут ссылки на все созданные XML-файлы.

Как создать карту сайта и добавить ее в панели веб-мастеров

Создать XML-карту помогут разные веб-инструменты и программы. Эта опция есть и в SE Ranking — в разделе «Аудит сайта».

В этом инструменте можно выбрать, какие типы страниц включить в карту, указать частоту изменения страниц и приоритет сканирования для страниц разного уровня.

Файл с картой нужно добавить на сам сайт (загрузить в корень сайта https://yoursite/sitemap.xml), а затем отправить в Google.

Чтобы отправить карту в Google Search Console, укажите ссылку на размещенную на вашем сайте карту. Сделать это можно в разделе «Файлы Sitemap».

Как только карта сайта будет просканирована роботами, вы получите отчет о том, какие страницы сайта попали в индекс поисковика и какие ошибки были при этом обнаружены.

3. Соберите качественные обратные ссылки

Чем больше качественных обратных ссылок у вашего веб-сайта, тем больше причин у поисковых роботов обратить на него внимание. Ведь если кто-то ссылается на ваши страницы, значит, они кому-то важны.

Для индексации лучше всего работают ссылки из соцсетей и новостных порталов. Дело в том, что они популярны, часто обновляют контент и, тем самым, «стимулируют» поисковых роботов как можно чаще сканировать ресурс. Если ваша ссылка появилась на таком сайте, ее, скорее всего, быстро обнаружит поисковый робот ― шансы есть даже у nofollow-ссылок.

Кстати, в этом году Google изменил правила для nofollow-ссылок. С 1 марта 2020 атрибут nofollow становится рекомендательным. Это значит, есть вероятность, что поисковик будет переходить по nofollow-ссылкам и индексировать их.

Как же получать качественные ссылки с других ресурсов? Начните с разработки стратегии по получению бэклинков. Несколько идей: разместите ссылку на ваш ресурс на тематических форумах, сервисах вопросов и ответов, сайтах-агрегаторах и т.д. Пробуйте все подходящие (и законные) способы .

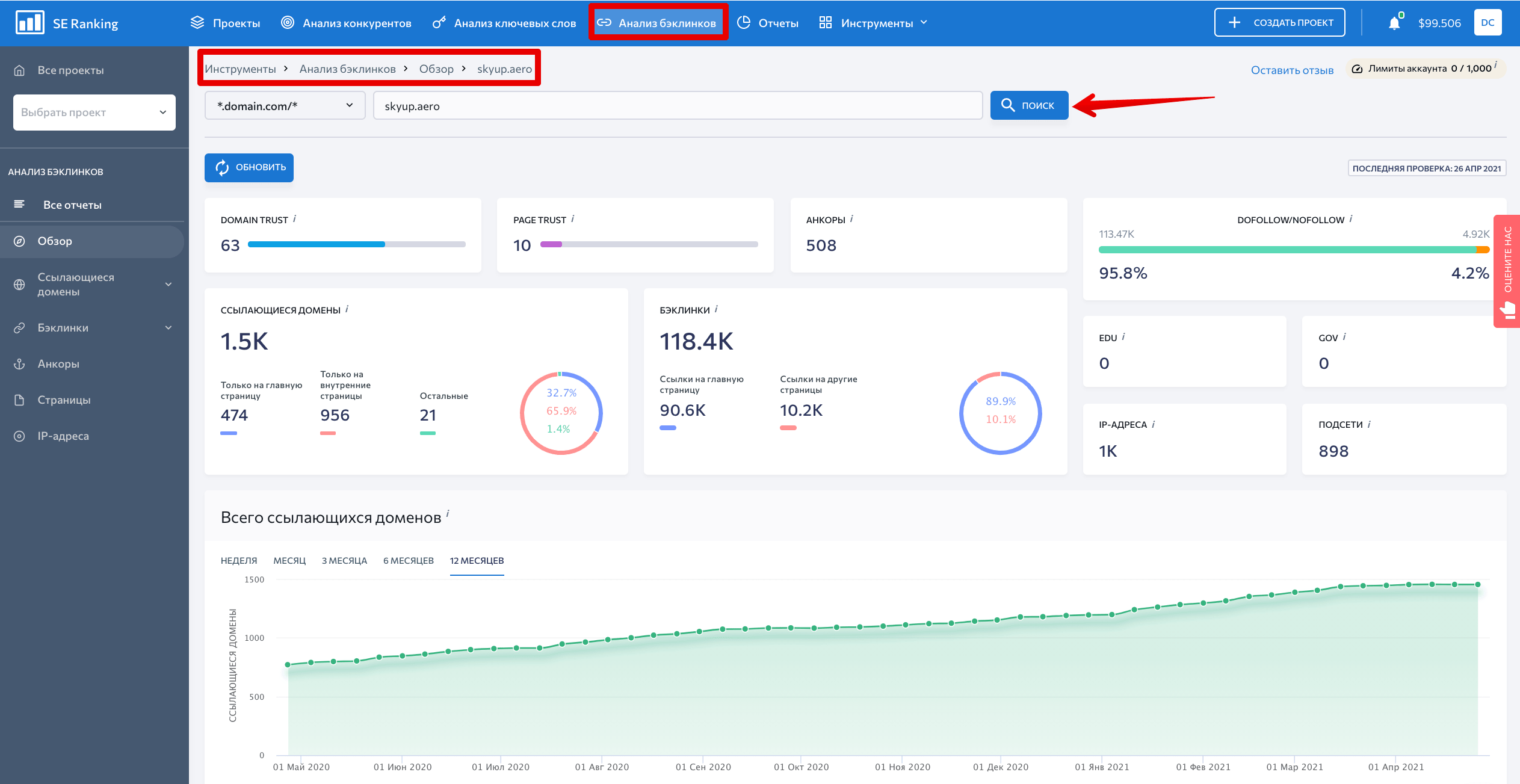

Если идеи по получению ссылок уже закончились, можно подсмотреть их у ваших конкурентов — собрать площадки для потенциального размещения бэклинков из ссылочного профиля сайта-конкурента. С этим поможет разобраться инструмент « Анализ обратных ссылок » от SE Ranking.

Что нужно делать? Все просто — зарегистрируйте бесплатный пробный аккаунт , откройте «Анализ обратных ссылок» и введите в поисковое поле URL домена конкурента.

Увидите список сайтов, которые ссылаются на вашего конкурента. Сможете оценить контекст, в котором дана ссылка, якорный текст и параметры ресурса. Все нужные данные в одной таблице — так отобрать доноров ссылок гораздо быстрее.

Отдельно стоит сказать о соцсетях.

Поисковые роботы активно «мониторят» соцсети, потому что новые материалы там появляются каждую секунду. Чтобы использовать эту особенность для своего сайта, нужно укрепить его присутствие на социальных площадках.

Просто добавить ссылку на сайт в шапку профиля не достаточно. Чтобы поисковой робот заинтересовался страницей компании, она должны быть популярной — иметь подписчиков, лайки, комментарии и репосты.

Еще ссылки на сайт и страницы можно размещать в постах, комментариях, описаниях к мультимедийным файлам, заметках, личных профилях (например, как место работы или партнерство), группах и сообществах (как ваших, так и чужих по вашей теме). Главное позаботиться о том, чтобы ссылки были к месту.

На первом месте по скорости сканирования ссылок Twitter — он быстро индексируется Google. Также поисковик индексирует ссылки с активных страниц в Facebook.

Общее правило индексации разных соцсетей поисковиками — чем больше социальной активности вы привлечете на свои публикации, тем больше у вас шансов «пригласить» краулеров соцсетей. А они ходят в гости парами, приглашая с собой на ваши страницы роботов поисковых систем.

4. Увеличьте скорость загрузки сайта

Есть такой понятие — краулинговый бюджет. Оно означает максимальное количество страниц, которое поисковой робот может просканировать за один визит. И чем дольше грузятся ваши страницы, тем меньше поисковые роботы просканируют за один раз.

Именно поэтому скорость загрузки так важна для индексации страниц.

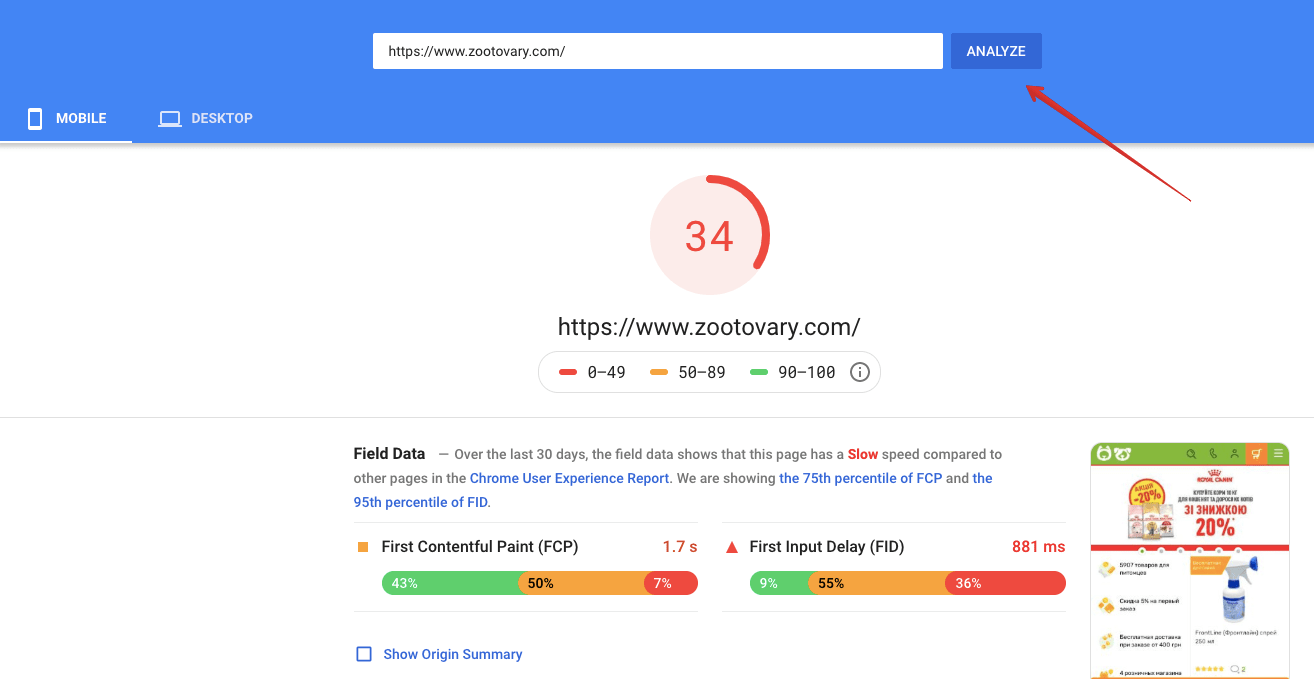

Вы можете оценить скорость загрузки любой страницы на вашем сайте с помощью инструмента PageSpeed Insights. Он покажет вам данные по скорости, что можно улучшить и сколько времени вы сэкономите при дальнейших загрузках, если исправите обнаруженные ошибки.

Если вы хотите узнать скорость всех страниц сайта, перейдите в Google Search Console → Улучшения → Отчет о скорости загрузки . Страницы будут разделены по группам — с низкой, средней и высокой скоростью для компьютера и мобильных.

Посмотрите на страницы «с низкой скоростью» — увидите, какие проблемы поисковик обнаружил при сканировании. Устранив описанные проблемы, можно нажать «Проверить исправление» и следить за ходом проверки.

Здесь вы сможете проверить среднее время загрузки всего сайта, время загрузки каждой отдельной страницы и турбо-страниц. Данные в отчете показаны для каждого этапа загрузки страницы (обработка запросов к DNS, обработка HTTP-редиректов, продолжительность установки соединения с браузером, ответ сервера, время загрузки и парсинга HTML и т.д.). Обнаружив самый долгий этап, вы можете начать с оптимизации его загрузки в первую очередь.

5. Выстройте хорошую перелинковку и навигацию по сайту

Внутренняя перелинковка сайта построит ссылочные мостики для поисковых ботов и «поведет» их в нужном направлении — от одной страницы вашего сайта к следующей и т.д. Воспользуйтесь тем, что краулеры с большей вероятностью быстрее просканируют «популярные» страницы (с большим ссылочным весом и трафиком). И если на этих популярных страницах есть ссылки на новые, поисковики перейдут по ним и быстрее их просканируют. Чтобы это работало, нужно настроить правильную перелинковку .

Главное, чтобы внутренние ссылки были релевантными и не сбивали пользователей с толку. Но даже самая удачная перелинковка может со временем перестать работать — поэтому очень важно периодически проверять, как с ней обстоят дела на вашем сайте. Рекомендую воспользоваться понятной рабочей инструкцией в нашем блоге, где по полочкам разложено, как проанализировать внутреннюю перелинковку вашего ресурса и найти все связанные с ней ошибки.

Другой важный момент — навигация на сайте. Она тоже влияет на скорость сканирования и индексации. Основные правила хорошей навигации: будьте логичными и последовательными, добавьте хлебные крошки , старайтесь сокращать путь к страницам до 3 кликов, откажитесь от меню на скриптах и flash, чтобы не усложнять процесс сканирования.

Помните, что ваш сайт должен быть простым и понятным как для поисковых роботов, так и для посетителей.

6. Регулярно публикуйте и обновляйте контент

Поисковикам нет смысла заходить на ваш сайт, если на нем ничего не меняется. Если же свежий контент появляется на вашем сайте регулярно, поисковые боты тоже зачастят на ваш веб-ресурс.

Вы можете создать график публикаций новых страниц на сайте (например, статей или обзоров в блоге) и придерживаться этого плана. Но не стоит публиковать новый контент ради «галочки» — он должен нести ценность для читателей вашего ресурса и не повторять то, что уже есть на сайте.

Много похожих страниц негативно отразятся на индексации всего сайта, особенно если речь идет о больших ресурсах. Также не в вашу пользу сработают публикации, в которых есть неуникальный контент, плохой рерайт, мало смысла и много воды.

Что можно предпринять, чтобы контент на вашем сайте помог с ускорением индексации:

- публикуйте новый контент как минимум раз в неделю;

- проставьте ссылки между новыми и старыми материалами;

- обновляйте устаревшую информацию на сайте;

- убедитесь, что публикуете качественный и уникальный контент .

7. Используйте сервисы пингования

Пингование — еще один способ оповещения поисковых систем о новом контенте. Когда вы отправляете пинг (сигнал), вы как будто «призываете» поисковых роботов прийти и проверить новый контент на вашем сайте.

Специальные пинг-сервисы, например Pingomatic , Pingler , Pingoat , встраиваются в движок вашего сайта и автоматически отправляют пинги поисковым системам, ускоряя процесс индексации.

В админке WordPress предусмотрена такая функция — в настройках нужно выбрать Написание → Сервисы обновления — и там указать список пинг-сервисов.

При использовании таких инструментов обязательно добавляйте только свежий контент и важные обновления, а также не переусердствуйте с отправлением пингов, чтобы поисковики не решили, что вы их спамите. Если планируете использовать автоматическое оповещение, вам пригодятся специальные WP-плагины для кастомной настройки пингования ― как часто отправлять пинги, после каких правок и т.д.

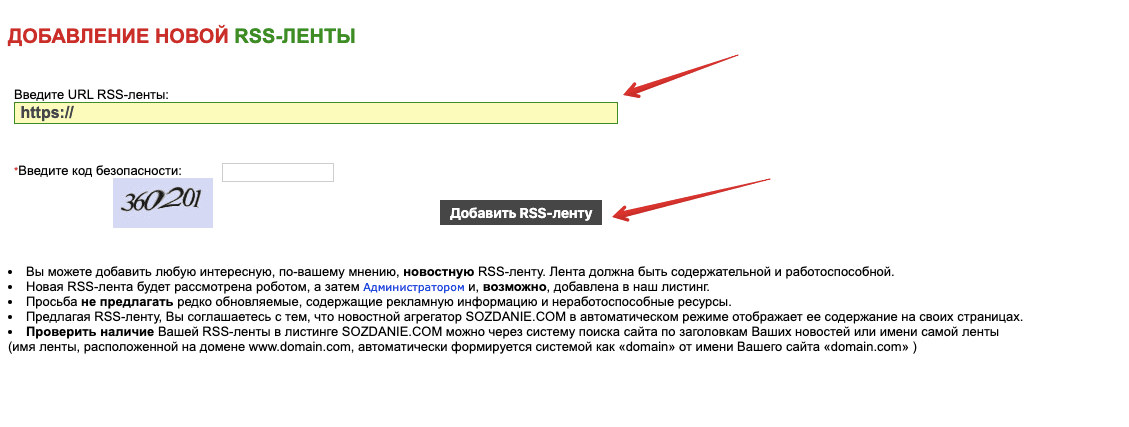

8. Добавьте сайт в RSS-агрегаторы

Сообщать поисковикам о новом контенте на вашем сайте можно через RSS-агрегаторы.

RSS — это формат для публикации новостей, который отлично подходит для отслеживания изменений на сайте без необходимости заходить на сам ресурс. Его используют для создания новостных лент (RSS feed), которые отображаются в самых разных RSS-агрегаторах, рейтингах и каталогах.

Чтобы создать новостную ленту для вашего сайта (пример для WordPress), просто добавьте в адрес вашего ресурса слово feed — получится что-то вроде https://yoursite/feed .

Следующий шаг — зарегистрировать вашу ленту в FeedBurner . Это сервис Google, который приводит все новостные ленты к стандартному формату и помогает ее настроить.

Теперь вы готовы добавлять сгенерированную в FeedBurner ленту в различные агрегаторы и каталоги.

Среди бесплатных RSS-агрегаторов, куда можно добавить свою новостную ленту:

- Subscribe.ru

Несколько рейтингов, куда можно добавить свою ленту:

- Топ-100 Рамблер

- Top.Mail.Ru

- Liveinternet

Обычно для добавления ленты в агрегатор достаточно указать название самой ленты, ее описание, URL сайта, ваш email и категорию (тематику новостей).

После добавления новостной ленты в RSS-агрегаторы все анонсы ваших материалов будут появляться там автоматически, привлекая поисковых роботов на ваш ресурс.

Действовать или ждать

Процесс сканирования и индексирования сайта требует вашего постоянного внимания и контроля. Если вы обнаружили проблемы с индексацией, не ждите, пока поисковики сами все решат.

Нужно действовать! Пробуйте методы ускорения индексации, о которых я писала выше ― каждый из них может дать «зеленый свет» для поисковых роботов. Осталось только выбрать наиболее подходящий вариант или комбинацию способов для вашего ресурса.

Уже пробовали какой-то из них или знаете другой рабочий прием? Пожалуйста, поделитесь с нами в комментариях. И пусть ни одна важная страница на вашем сайте не останется без индексации!